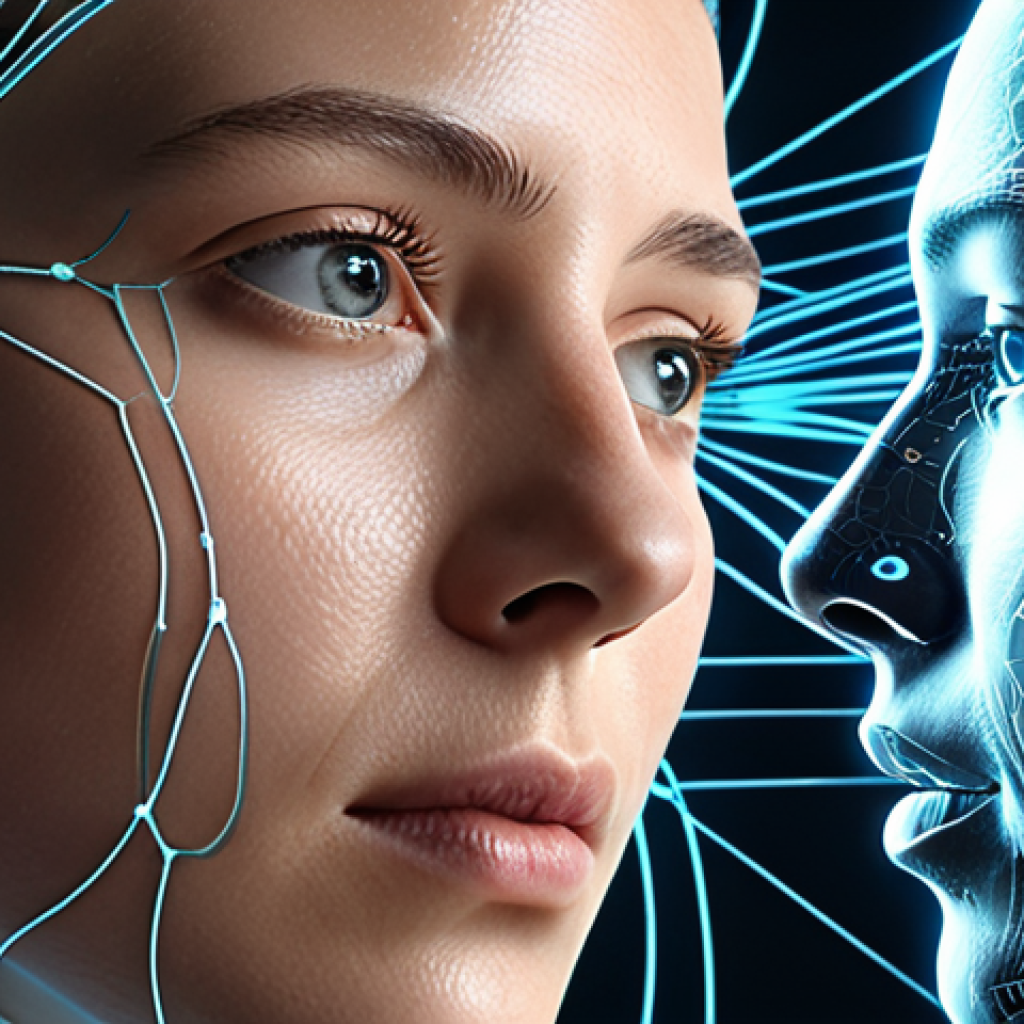

De wereld van kunstmatige intelligentie staat nooit stil, en een van de meest fascinerende ontwikkelingen die ik de laatste tijd met verbazing volg, is die van AI-gestuurde emotieherkenning.

Het is niet langer een futuristisch concept uit films; deze technologie sijpelt nu al door in diverse sectoren, van klantenservice tot de gezondheidszorg, en transformeert hoe bedrijven met ons omgaan.

Eerlijk gezegd, het voelt soms een beetje ongemakkelijk om te bedenken dat een algoritme ‘begrijpt’ hoe ik me voel, maar aan de andere kant opent het de deuren naar ongekende personalisatie en empathie in de digitale wereld.

Denk aan een chatbot die direct aanvoelt dat je gefrustreerd raakt, of een app die je gemoedstoestand analyseert om betere content aan te bieden. Deze verschuiving in hoe we technologie ervaren, is iets waar we ons bewust van moeten zijn.

Laten we er eens dieper in duiken. De vooruitgang op het gebied van multimodal AI, die niet alleen stem, maar ook gezichtsuitdrukkingen en lichaamstaal analyseert, is werkelijk verbluffend en begint langzaam maar zeker de weg te vinden naar alledaagse applicaties.

Stel je voor dat je favoriete online winkel de emotie achter je zoekopdrachten kan interpreteren om je nóg relevantere producten te tonen, of dat in het onderwijs tools helpen om te herkennen wanneer een leerling worstelt.

Natuurlijk roept dit ook belangrijke ethische vragen op, vooral rondom privacy en de implementatie binnen de strenge GDPR-regels hier in Europa. De balans tussen innovatie en de bescherming van individuele gegevens is cruciaal.

We staan op het punt van een nieuw tijdperk waarin technologie onze emoties niet alleen detecteert, maar er ook op een steeds verfijndere manier op reageert, wat zowel enorme kansen als onvermijdelijke uitdagingen met zich meebrengt voor de maatschappij van de toekomst.

De wereld van kunstmatige intelligentie staat nooit stil, en een van de meest fascinerende ontwikkelingen die ik de laatste tijd met verbazing volg, is die van AI-gestuurde emotieherkenning.

Het is niet langer een futuristisch concept uit films; deze technologie sijpelt nu al door in diverse sectoren, van klantenservice tot de gezondheidszorg, en transformeert hoe bedrijven met ons omgaan.

Eerlijk gezegd, het voelt soms een beetje ongemakkelijk om te bedenken dat een algoritme ‘begrijpt’ hoe ik me voel, maar aan de andere kant opent het de deuren naar ongekende personalisatie en empathie in de digitale wereld.

Denk aan een chatbot die direct aanvoelt dat je gefrustreerd raakt, of een app die je gemoedstoestand analyseert om betere content aan te bieden. Deze verschuiving in hoe we technologie ervaren, is iets waar we ons bewust van moeten zijn.

Laten we er eens dieper in duiken. De vooruitgang op het gebied van multimodal AI, die niet alleen stem, maar ook gezichtsuitdrukkingen en lichaamstaal analyseert, is werkelijk verbluffend en begint langzaam maar zeker de weg te vinden naar alledaagse applicaties.

Stel je voor dat je favoriete online winkel de emotie achter je zoekopdrachten kan interpreteren om je nóg relevantere producten te tonen, of dat in het onderwijs tools helpen om te herkennen wanneer een leerling worstelt.

Natuurlijk roept dit ook belangrijke ethische vragen op, vooral rondom privacy en de implementatie binnen de strenge GDPR-regels hier in Europa. De balans tussen innovatie en de bescherming van individuele gegevens is cruciaal.

We staan op het punt van een nieuw tijdperk waarin technologie onze emoties niet alleen detecteert, maar er ook op een steeds verfijndere manier op reageert, wat zowel enorme kansen als onvermijdelijke uitdagingen met zich meebrengt voor de maatschappij van de toekomst.

De complexe wereld van AI en emotie: Meer dan algoritmes

Toen ik voor het eerst las over de ontwikkelingen in AI-gestuurde emotieherkenning, was mijn eerste reactie een mix van fascinatie en een lichte huiver. Hoe kan een machine, die geen menselijke ervaringen of biologische impulsen heeft, écht emoties begrijpen? Maar wat ik zelf merkte, is dat het niet gaat om een diepgaand, menselijk begrip, maar om het herkennen van patronen. Denk aan een glimlach, een frons, een stem die trilt of een zucht; deze zijn allemaal meetbaar. De AI wordt getraind op enorme datasets van menselijke uitdrukkingen en geluiden, en leert zo welke patronen overeenkomen met welke emoties. Het is een beetje zoals het herkennen van een taal zonder die echt te ‘voelen’. Mijn eigen ervaring met sommige chatbots die steeds beter reageren op mijn frustratie, toont aan dat zelfs een rudimentair begrip al een wereld van verschil maakt in de interactie. Het voelt bijna alsof de technologie een empathische sprong voorwaarts maakt.

1. De technische grondbeginselen: Hoe werkt het precies?

De kern van emotieherkenning ligt in geavanceerde machine learning-algoritmes. Deze algoritmes analyseren diverse inputs. Denk hierbij aan:

- Spraakanalyse: Toonhoogte, volume, spreektempo en intonatie worden geëvalueerd om emotionele staten zoals boosheid, vreugde of verdriet te detecteren.

- Gezichtsanalyse: Via computer vision worden micro-uitdrukkingen, oogbewegingen en gezichtsspieren geanalyseerd. Een opgetrokken wenkbrauw of een licht gespannen mond kan al een indicatie geven.

- Lichaamstaal: Hoewel complexer, kunnen sensoren en camera’s ook houding, gebaren en bewegingen interpreteren.

De combinatie van deze ‘multimodale’ input levert een veel completer beeld op dan elke methode afzonderlijk. Ik zag recentelijk een demo waarbij een AI mijn algemene gemoedstoestand wist te bepalen door alleen naar mijn stem te luisteren, en dat was behoorlijk indrukwekkend.

2. Van patroonherkenning naar ‘emotionele intelligentie’?

Het is cruciaal om te onthouden dat AI geen emoties voelt. Het is patroonherkenning op steroïden, en dat is een belangrijk verschil. Toch bootst het gedrag van ’emotionele intelligentie’ na, en dat is waar de magie – en soms de bezorgdheid – begint. De AI reageert op een manier die past bij de herkende emotie, wat de interactie menselijker maakt. Dit kan leiden tot een meer bevredigende gebruikerservaring, maar ook tot vragen over authenticiteit en manipulatie. Ik vraag me af, hoe ver gaat dit nog? Is het echt ‘intelligent’ of alleen ‘geavanceerd reagerend’?

De invloed van emotieherkenning op ons dagelijks leven

De toepassingen van AI-gestuurde emotieherkenning zijn breder dan je op het eerste gezicht zou denken. Ik zag onlangs een reportage over hoe het in callcenters wordt gebruikt om de frustratie van bellers te meten, zodat een medewerker sneller kan ingrijpen. Maar het gaat verder dan dat, tot in sectoren waar je het misschien niet direct verwacht. Mijn vriendin, die veel online shopt, merkte dat bepaalde webwinkels plotseling veel relevantere aanbevelingen gaven nadat ze een periode gestrest was over haar werk, en de AI blijkbaar haar gemoedstoestand uit haar zoekgedrag had opgevangen. Dat zette me wel aan het denken: hoe diep kruipt dit eigenlijk in onze digitale interacties?

1. De commerciële arena: Klantbeleving en marketing

In de commerciële wereld is emotieherkenning een gamechanger. Het gaat niet langer alleen om wat je koopt, maar ook hoe je je voelt terwijl je shopt of een service gebruikt. Bedrijven kunnen nu hun aanpak personaliseren op basis van de emotionele staat van de klant. Denk hierbij aan:

- Gepersonaliseerde aanbiedingen: Als de AI detecteert dat je gestrest bent, kan een wellness-merk je ontspannende producten aanbevelen.

- Verbeterde klantenservice: Chatbots kunnen hun toon aanpassen, excuses aanbieden of direct doorverbinden met een menselijke medewerker als ze frustratie waarnemen.

- Advertentietests: Marketeers kunnen reacties van consumenten op advertenties testen door hun emotionele respons te meten, nog voordat de campagne breed wordt uitgerold.

Ik heb zelf wel eens gemerkt dat een webshop me met een heel rustige en begripvolle toon antwoordde toen ik gefrustreerd was over een levering. Dat maakte echt een verschil in mijn perceptie van het merk.

2. De impact op de entertainmentindustrie: Content op maat

Ook de entertainmentindustrie pikt deze technologie op. Denk aan streamingdiensten die niet alleen aanbevelingen doen op basis van je kijkgeschiedenis, maar ook op basis van je humeur. Ben je chagrijnig? Dan krijg je misschien een komedie voorgeschoteld die je gegarandeerd opvrolijkt. Sommige games passen zelfs de moeilijkheidsgraad of de sfeer aan op basis van de emoties van de speler, wat een veel immersievere ervaring creëert. Het voelt als een nieuw niveau van personalisatie, alsof de content echt met je meeleeft.

Emotieherkenning in de zorg en het onderwijs: Een empathische partner?

Toen ik me verdiepte in de toepassingen van emotieherkenning buiten de commerciële sfeer, kwam ik tot de conclusie dat de grootste potentie misschien wel ligt in de zorg en het onderwijs. Hier kan AI echt een verschil maken in het leven van mensen, op een manier die verder gaat dan winstbejag. Stel je voor dat een verpleegrobot subtiel kan detecteren wanneer een patiënt pijn heeft, nog voordat deze het zelf kan aangeven. Of een leersysteem dat merkt dat een student vastloopt en direct aanvullende uitleg of een pauze voorstelt. Ik ben ervan overtuigd dat dit de menselijke capaciteiten kan versterken, niet vervangen, en dat vind ik een heel geruststellende gedachte.

1. Verbeterde zorg en mentaal welzijn

In de gezondheidszorg kan emotieherkenning een revolutionaire rol spelen, vooral op het gebied van mentaal welzijn en patiëntenzorg. Ik hoorde een voorbeeld van een pilotproject in een Nederlands ziekenhuis, waar AI hielp bij het monitoren van ouderen. De AI kan veranderingen in stemmingen of tekenen van eenzaamheid detecteren, zodat zorgverleners proactief kunnen handelen. Dit kan onder andere leiden tot:

- Vroegtijdige detectie van stress of depressie.

- Gepersonaliseerde therapieën, waarbij de AI reageert op de emotionele staat van de cliënt.

- Ondersteuning voor mensen met communicatieproblemen, bijvoorbeeld na een beroerte.

Het idee dat technologie op deze manier kan bijdragen aan ons welzijn, geeft me echt hoop voor de toekomst van de zorg.

2. Dynamisch onderwijs en studentenondersteuning

Ook in het onderwijs liggen er enorme kansen. Een AI die de emotionele staat van een student kan inschatten, kan het leerproces aanzienlijk verbeteren. Ik stel me voor dat een online leerplatform ziet dat een student gefrustreerd raakt door een bepaalde oefening, en dan automatisch hints geeft, een eenvoudiger alternatief aanbiedt, of zelfs een korte pauze voorstelt. Dit kan onder meer inhouden:

- Adaptieve leerprogramma’s die zich aanpassen aan de mentale staat van de leerling.

- Detectie van verveling of afleiding om de lesstof boeiender te maken.

- Vroegtijdige signalering van leerproblemen of stress bij studenten.

Als docent had ik hier veel aan gehad! Het zou leerlingen echt kunnen helpen om op hun eigen tempo en manier het meeste uit hun studie te halen.

De ethische en privacykwesties: Een delicate balans

Naast alle veelbelovende toepassingen roept emotieherkenning ook de nodige ethische vragen op. En terecht, vind ik. Want hoe zit het met onze privacy als machines onze diepste gevoelens kunnen analyseren? Wie heeft toegang tot deze data, en waarvoor wordt die gebruikt? Vooral in Europa, met de strikte GDPR-wetgeving, is dit een heikel punt. Ik ben een groot voorstander van innovatie, maar niet ten koste van fundamentele rechten. Het voelt soms een beetje als een spion in je eigen huis, zelfs als de intenties goed zijn. Deze discussie moeten we voeren, en wel nu.

1. De grens van privacy en databeveiliging

De belangrijkste zorg is ongetwijfeld privacy. Emotionele data is extreem gevoelig en kan misbruikt worden voor doeleinden die verder gaan dan alleen het verbeteren van de gebruikerservaring. Denk aan:

- Gerichte manipulatie: Als een bedrijf weet dat je onzeker bent, kunnen ze je producten aanbieden die hierop inspelen.

- Discriminatie: Emotionele profielen kunnen leiden tot uitsluiting of oneerlijke behandeling, bijvoorbeeld bij sollicitaties of het afsluiten van verzekeringen.

- Surveillance: De mogelijkheid om emoties te monitoren op grote schaal, zonder expliciete toestemming, is een eng vooruitzicht.

Ik denk dat we hier strenge wetgeving en duidelijke kaders voor nodig hebben. Het is essentieel dat gebruikers altijd de controle behouden over hun eigen emotionele data. Wie eigenaar is van die data, en hoe we die beschermen, dat is de cruciale vraag.

2. Voorkomen van vooroordelen en misinterpretatie

Een ander belangrijk ethisch vraagstuk is de mogelijkheid van vooroordelen en misinterpretatie. AI-modellen worden getraind op datasets, en als deze datasets bevooroordeeld zijn (bijvoorbeeld door oververtegenwoordiging van bepaalde demografieën), dan kan de AI emoties van andere groepen verkeerd interpreteren. Wat voor de ene cultuur een neutrale uitdrukking is, kan in een andere cultuur als boosheid worden opgevat. Dit kan leiden tot onjuiste conclusies en, in het ergste geval, tot stigmatisering. Het is een complex probleem, omdat het vaak onzichtbaar is in de code. Als ervaringsdeskundige weet ik dat de nuance van menselijke emotie ontzettend moeilijk te vangen is in een algoritme, en dat dit potentieel tot grote misverstanden kan leiden. We moeten waakzaam zijn voor de ‘black box’ van AI en blijven eisen dat de systemen transparant en eerlijk zijn.

Innovatieve toepassingen versus de maatschappelijke acceptatie

Het is fascinerend om te zien hoe snel de technologie zich ontwikkelt, maar ik vraag me altijd af: hoe snel accepteert de maatschappij dit? We zijn nog steeds bezig met de acceptatie van zelfrijdende auto’s, laat staan AI die onze emoties ‘leest’. Er is een duidelijke spanning tussen wat technisch mogelijk is en wat maatschappelijk wenselijk en acceptabel is. De angst voor een surveillance-maatschappij is reëel, en die angst wordt gevoed door verhalen over misbruik van data. Maar tegelijkertijd zijn de voordelen – zeker in de zorg – zo groot dat het zonde zou zijn om de technologie te negeren. Het gaat om een balans, en die balans vinden we alleen door open discussie en duidelijke regels.

1. De rol van transparantie en uitlegbaarheid

Om maatschappelijke acceptatie te vergroten, is transparantie cruciaal. Mensen moeten begrijpen hoe de AI werkt en hoe hun emotionele data wordt gebruikt. Ik denk dat ontwikkelaars veel meer moeten doen aan ‘explainable AI’ (XAI), zodat we kunnen zien waarom een AI tot een bepaalde conclusie komt. Dit geldt des te meer voor emotieherkenning. Als een AI claimt dat ik gestrest ben, wil ik weten op basis van welke signalen die conclusie getrokken is. Dat bouwt vertrouwen op. Zonder dit blijft het een eng, ondoorzichtig concept waar we ongemakkelijk van worden.

2. De publieke dialoog en regelgeving

Een open en eerlijke dialoog over de voor- en nadelen van emotieherkenning is hard nodig. Burgers, beleidsmakers, technologie-experts en ethici moeten samenwerken om de kaders te bepalen. Ik pleit voor robuuste regelgeving die zowel innovatie stimuleert als fundamentele rechten beschermt. Denk aan richtlijnen voor het verzamelen, opslaan en gebruiken van emotionele data, en duidelijke opt-in en opt-out mogelijkheden. Zonder dit riskeert de technologie vast te lopen op weerstand, en dat zou zonde zijn van de potentieel positieve impact die het kan hebben.

Mijn persoonlijke reflectie: Een blik op de AI-emotie van morgen

Als ik eerlijk ben, de ontwikkelingen rondom AI en emotieherkenning roepen bij mij zowel verwondering als een diepe nieuwsgierigheid op. Ik heb altijd al een fascinatie gehad voor menselijke emoties en de complexiteit ervan, en het idee dat een machine hierin iets kan ‘begrijpen’ – zelfs als het patroonherkenning is – blijft me boeien. Het voelt alsof we aan de vooravond staan van een heel nieuwe manier van interacteren met technologie, waarbij de machines niet meer passief zijn, maar actief reageren op onze innerlijke staat. Maar deze sprong brengt ook een enorme verantwoordelijkheid met zich mee. Hoe zorgen we ervoor dat deze technologie ons helpt en niet beheerst?

1. De menselijke factor blijft leidend

Ondanks de indrukwekkende vooruitgang ben ik ervan overtuigd dat de menselijke factor altijd leidend moet blijven. AI kan ons ondersteunen, aanvullen en zelfs waarschuwen, maar het kan nooit de complexe diepgang van menselijke empathie en intuïtie volledig vervangen. Ik heb zelf ervaren dat, hoe goed een chatbot ook de intentie van mijn vraag aanvoelt, er uiteindelijk niets boven het persoonlijke contact met een mens gaat als het écht complex wordt. AI is een krachtige tool, maar tools zijn er om ons te dienen, niet om ons te dicteren.

2. Een toekomst vol mogelijkheden en uitdagingen

De toekomst van AI-gestuurde emotieherkenning is een tweesnijdend zwaard. Aan de ene kant liggen er ongekende mogelijkheden voor personalisatie, efficiëntie en een meer empathische digitale wereld. Denk aan hulpmiddelen voor mensen met autisme, of het sneller opsporen van emotionele nood bij kwetsbare groepen. Aan de andere kant liggen er uitdagingen op het gebied van privacy, ethiek en het voorkomen van misbruik. Het navigeren door dit nieuwe landschap vereist voortdurende discussie, ontwikkeling van strenge ethische richtlijnen, en een bewuste houding van ons als gebruikers. Het is een reis die we samen moeten maken, met open ogen en een kritische blik. Ik ben benieuwd waar het ons zal brengen.

| Aspect van Emotieherkenning | Kansen | Uitdagingen |

|---|---|---|

| Personalisatie | Meer relevante aanbevelingen, betere klantbeleving | Risico op manipulatie, privacyinbreuk |

| Gezondheidszorg | Vroegtijdige detectie van mentale problemen, verbeterde patiëntenzorg | Misinterpretatie van emoties, ethische dilemma’s rondom diagnose |

| Onderwijs | Adaptieve leerprogramma’s, gerichte studentenondersteuning | Vooroordelen in data, afhankelijkheid van technologie |

| Arbeidsmarkt | Efficiëntere teams, stressreductie op de werkvloer | Discriminatie bij sollicitaties, monitoring van werknemers |

Conclusie

De reis naar een toekomst waarin AI onze emoties ‘begrijpt’, is zowel opwindend als complex. We zien ongekende mogelijkheden voor personalisatie in commercie, empathische ondersteuning in de zorg, en dynamische leermethoden in het onderwijs.

Tegelijkertijd staan we voor serieuze ethische dilemma’s rondom privacy, potentiële manipulatie en het voorkomen van vooringenomenheid. De menselijke factor moet altijd centraal blijven staan; AI is een hulpmiddel, geen vervanging voor diepgaande menselijke verbinding.

Laten we samen de dialoog aangaan om deze krachtige technologie op een verantwoorde manier in te zetten voor een betere toekomst.

Handige Informatie

1. Lees de kleine lettertjes: Controleer altijd het privacybeleid van apps en services die claimen emotieherkenning te gebruiken. Wees bewust van welke data wordt verzameld en hoe deze wordt gebruikt.

2. GDPR is je vriend: In Europa hebben we de Algemene Verordening Gegevensbescherming (AVG). Deze wet geeft je het recht op inzage, correctie en verwijdering van je persoonsgegevens. Maak hier gebruik van.

3. Kies bewust: Bepaal zelf of je wel of niet wilt dat een technologie je emoties probeert te lezen. Er zijn vaak instellingen om deze functies uit te schakelen.

4. Blijf kritisch: Onthoud dat AI emoties niet ‘voelt’. Het is patroonherkenning. Interpreteer de resultaten van emotieherkenning altijd met een gezonde dosis scepsis en menselijk inzicht.

5. Neem deel aan de discussie: De ontwikkeling van AI-ethiek is een doorlopend proces. Informeer jezelf en draag bij aan de publieke dialoog over de grenzen en mogelijkheden van emotieherkenning.

Belangrijke Samenvatting

AI-gestuurde emotieherkenning analyseert patronen in stem, gezicht en lichaamstaal om menselijke emoties te interpreteren, wat leidt tot revolutionaire toepassingen in sectoren als klantenservice, gezondheidszorg en onderwijs.

Hoewel het ongekende personalisatie en efficiëntie belooft, roept het ook belangrijke ethische vragen op over privacy, databeveiliging en het risico op misinterpretatie of manipulatie.

Transparantie, strenge regelgeving en een voortdurende maatschappelijke dialoog zijn essentieel om een evenwicht te vinden tussen innovatie en de bescherming van fundamentele rechten, waarbij de menselijke factor leidend blijft.

Veelgestelde Vragen (FAQ) 📖

V: Wat zijn nu de meest concrete, tastbare voordelen die we al merken of snel gaan merken van deze emotieherkenning AI in ons dagelijks leven?

A: Nou, ik zie zelf wel een aantal hele interessante toepassingen voor me, die we al zien of die er snel aankomen. Denk bijvoorbeeld aan de klantenservice.

Ik heb zelf wel eens gefrustreerd achter mijn laptop gezeten met een chatbot die mijn probleem maar niet begreep, en dan denk ik: ‘Als die nu écht had aangevoeld hoe ik me voelde, dan was het veel sneller opgelost geweest!’ Of denk aan apps die je gemoedstoestand meenemen bij het aanbieden van content, zoals muziek of nieuws.

Geen vrolijke deuntjes als je net een rotdag hebt, snap je? En in de gezondheidszorg, hoe fantastisch zou het zijn als een AI kan helpen om vroegtijdig signalen van stress of zelfs depressie te herkennen door bijvoorbeeld stemanalyse?

Het opent echt deuren naar een veel persoonlijkere en empathischere digitale ervaring.

V: Hoe zit het met de privacy? Is het niet een beetje eng dat AI onze emoties kan ‘lezen’ en hoe kunnen we er zeker van zijn dat onze gegevens veilig zijn, zeker met die GDPR in gedachten?

A: Dit is mijn grootste zorg, eerlijk gezegd. Het idee dat een algoritme weet of ik blij, boos of gefrustreerd ben, voelt toch een beetje als een inbreuk op mijn persoonlijke ruimte.

Gelukkig hebben we hier in Europa de GDPR, die echt een stevige basis biedt voor onze privacyrechten. Die dwingt bedrijven om transparant te zijn over welke gegevens ze verzamelen en hoe ze die gebruiken.

Maar de praktijk? Dat is waar het spannend wordt. Het blijft een tweesnijdend zwaard.

Het gaat erom hoe transparant bedrijven zijn en of wij als gebruikers écht de controle hebben over onze emotionele data. Je moet er niet aan denken dat dit voor ongewenste doeleinden wordt gebruikt, hè?

Het vraagt echt om constante waakzaamheid van zowel de wetgever als de consument.

V: Denkt u dat AI die emoties herkent uiteindelijk leidt tot een betere, menselijkere interactie, of juist tot een wereld waarin we ons meer geobserveerd voelen?

A: Dat is dé miljoenendollarvraag, vind ik. Enerzijds zie ik de potentie voor écht gepersonaliseerde zorg, onderwijs of zelfs reclame die niet irriteert maar daadwerkelijk helpt omdat het aansluit bij je stemming.

Stel je voor dat je online winkel niet alleen weet wat je eerder kocht, maar ook wanneer je behoefte hebt aan wat comfortshoppen na een stressvolle dag!

Dat is toch prachtig? Maar tegelijkertijd, het kan ook een beetje beklemmend voelen. Alsof je constant onder een vergrootglas ligt, en je emoties worden geanalyseerd voor commerciële of andere doeleinden waar je misschien niet achter staat.

Uiteindelijk denk ik dat het afhangt van de ontwikkeling van ethische kaders en ons eigen collectieve bewustzijn. Als we als maatschappij de regels goed opstellen en blijven eisen dat de menselijke maat voorop staat, dan kunnen we een win-winsituatie creëren.

Het is een delicate balans die we moeten vinden.

📚 Referenties

)

)

)

)